(广东省国土资源测绘院 ,广东广州, 510000)

摘要:遥感影像特征提取与分类是遥感影像解译的一个重要研究方向。在特征分类上,Softmax分类器和支持向量机已经被广泛应用于各种复杂高维数据分类任务并取得了良好的效果,目前的研究主要集中在如何获取图像高质量的特征表示上。随着遥感技术的发展,我国在提高遥感影像分辨率方面有了重大突破,通过高分系列卫星采集的遥感影像分辨率已经达到了米级甚至是亚米级。与中分辨率和低分辨率的遥感影像相比较,高分辨率遥感影像中包含了更加丰富和详尽的细节信息。可以准确的反映出地表类型以及空间布局,但是由于地表建筑的空间分布和几何结构相当繁杂,导致同谱异物和同物异谱的现象愈加严重,为高分遥感影像的分类带来了巨大的挑战。基于此,本篇文章对耦合多源地理数据的多分辨率遥感影像场景分类方法进行研究,以供参考。

关键词:耦合多源地理数据;多分辨率;遥感影像场景;分类方法

引言

相比遥感影像,高分遥感影像包含了丰富的空间细节信息,是对地精细观测的重要数据来源,能清晰表达地物目标的空间结构和纹理特征,更好地反映地物目标的尺寸、形状及相邻关系,使对地物目标的精确解译成为可能,已被广泛应用于土地利用、土地覆盖确定、自然灾害检测、城市规划、地理空间目标检测等领域[1]。但随着分辨率的提高,高分辨率影像场景数据量的大幅增加以及背景复杂性和目标多样性的不断增强给分类任务带来一定困难。此外,遥感场景是由语义目标基于某种空间分布构成的具有深层语义信息的复杂影像区域,在进行场景分类时,无关信息容易与目标区域混淆,导致分类精度降低。因此,如何有效提取高分遥感影像的目标信息和深层语义特征,从而实现场景的自动识别和分类对于高分影像的应用具有重要意义。

1研究区及数据

1.1研究区及数据简介

本研究选取武汉市为研究区。武汉市是湖北省的省会城市,同时也是华中地区的一大中心城市。本文所使用的研究数据包含遥感影像和多源地理数据。其中,遥感影像又分为超分辨率重建数据集、规则影像和不规则影像场景数据集、夜间灯光影像数据[2]。规则影像是指固定大小尺寸(如256pixel×256pixel)的影像块,适合输入到深度学习模型;而不规则影像是指大小形状不一的影像块。多源地理数据包含采集的武汉市研究区内的OSM,POI,RTUD。

1.2遥感影像

为了验证本文提出方法的有效性,使用数据集GoogleEarth影像遥感影像裁剪获得。该数据集是17000幅遥感影像,5个不同分辨率下的影像数据,此数据集在平移,光照,遮挡,背景,分辨率方面都有着很大的变化,并且有着较高的类内多样性和类间相似性,该数据集对于本文提出的方法有较高的挑战性。本文采用80%的数据作为训练样本,20%的数据作为测试样本,并且数据集未通过旋转,翻转,缩放,裁剪等手段进行数据增强。

1.3多源地理数据

(1)OSM路网及POI兴趣点数据。研究区的路网数据是本研究重要的地理数据之一,其来源于OpenStreetMap,属性字段包括道路等级等信息[3]。兴趣点数据来自高德地图,本研究获取了武汉市范围内的POI数据,包含名称、类型和位置等7种属性,共计886415条。OSM和POI数据可视化如图1所示。

图1武汉市OSM及POI数据

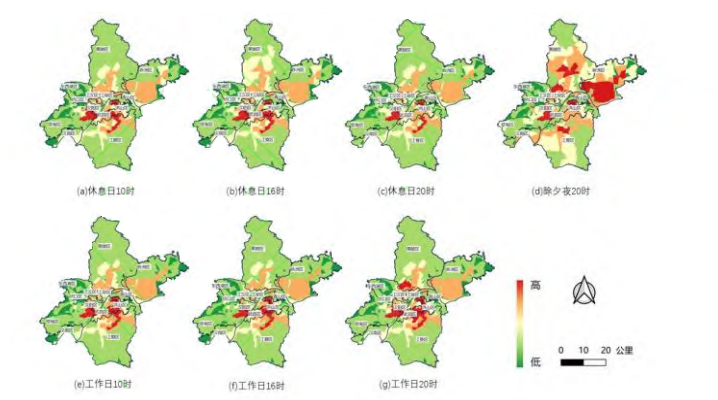

(2)实时人口时序RTUD数据

人口时序数据是按时间顺序记录人群在空间上的分布情况的数据序列,可以直观有效地反映空间区域的相关性,具有在时间上的动态性和空间上的全覆盖性。本研究使用来自腾讯人口时序数据库的RTUD数据辅助城市场景分类。武汉市人口时序数据如图2所示。

图2武汉市人口时序数据

2研究方法

2.1CNN融合的可行性分析

首先,通过深入分析SAE与CNN两种网络结构可以看出,二者均采用原理相同的前向传播和基于梯度下降的误差反向传播,在训练的过程中存在共性,具备网络融合的理论基础。其次,在完成SAE的训练后,可以提取编码器网络,结合Softmax分类器对SAE监督训练,实现网络参数的微调,实现更好的数据降维效果。基于以上2点,利用CNN网络代替原先网络中的Softmax分类器,进一步对降维后的数据进行特征提取[4]。最终在同一个网络中同时实现高维数据的降维与分类,充分利用SAE的数据降维能力与CNN的特征提取与分类能力,构建融合网络,同时实现高维数据的降维与分类,简化数据处理流程,并且使降维后的低维特征更加适合CNN进行分类,提高分类精度。

2.2多尺度分割方法

遥感影像多尺度分割的结果直接影响用地分类结果的好坏。因此,确定最优分割尺度对城市土地利用类型的确定是至关重要的。对于一种特定的土地利用类型,最优分割尺度应能够较好的显示地物的边界,不能出现过于破碎或模糊的现象。Woodcock等最先利用布局方差对影像进行多尺度分割,得到的结果精度较好。因此,选择局部方差法对研究区进行最优尺度分割。计算公式为:

𝑣𝑎𝑟= 2,式中:var为遥感影像的局部方差;x为影像对象的灰度值;

2,式中:var为遥感影像的局部方差;x为影像对象的灰度值; 为影像对象灰度值的平均值。经过计算,最终确定分割尺度为180,形状因子为0.5,紧致度因子为0.8。对影像进行分割。

为影像对象灰度值的平均值。经过计算,最终确定分割尺度为180,形状因子为0.5,紧致度因子为0.8。对影像进行分割。

3实验结果

3.1实验设计与评价

将本文方法与CNN方法进行对比,实现类似降维过程。在分类效果评估中,使用了总体分类精度(OverallAccuracy,OA)与Kappa系数作为分类性能的评估指标。对于本文提出的方法,预训练阶段采用较大的学习率,用于加速网络的收敛,节约预训练的时间。在整体训练的过程中,采用较小的学习率,让网络参数均得到最优解,优化参数“微调”效果。

3.2不规则遥感影像场景分类

在不规则MR-WUHAN数据集场景分类中,通过SVM分类器,2m影像的精度为75%,8m影像的精度为52.5%,多源地理数据的精度为46.25%,特征融合的精度为81.25%。从实验结果可以看出,仅使用影像特征和仅使用多源地理数据特征的模型精度均低于融合影像特征和多源地理数据特征的方法[5]。证明了多源地理数据特征可以很好地弥补社会经济属性等影像不能反映但却对场景类别影响很大的特征,因此通过特征融合可以获得更高的精度。

结束语

针对高分遥感影像的分类问题上,提出了一种基于显著性特征和CNN的高分遥感影像场景分类方法。该方法充分利用了影像的显著性特征和深层语义特征,通过对目标区域和背景区域的分割提取数据,从而提高模型对不同复杂程度场景的区分能力。利用构建的CNN对具有鉴别性的深层特征进行提取和分类,提高了分类精度。但本方法仍存在许多不足,如分类过程需要人工构建神经网络模型,如何根据不同高分影像的特点选择最优的网络层数和改进网络结构还需进行深入研究。此外,如何提高本方法在纹理、颜色相似度较高场景中的分类精度也是需要进一步完善的问题。

参考文献

[1]范鑫.耦合多源地理数据的多分辨率遥感影像场景分类方法研究[J/OL].无线电工程:1-15[2019-11-24].

[2]张普照.基于空时建模的遥感影像变化检测方法与应用[D].西安电子科技大学,2019.

[3]于新菊.图谱耦合的高分辨率城市精细不透水面提取方法研究[D].中国科学院大学(中国科学院遥感与数字地球研究所),2018.

[4]王娟.基于城镇影像的Contourlet域图像融合算法研究[D].成都理工大学,2018.

[5]石海潜.基于SOA的多源空间数据集成访问技术研究[D].国防科学技术大学,2018.