国家知识产权局专利局专利审查协作天津中心 天津 300304

摘要:近年来,随着人工智能技术飞速发展,该领域专利申请量大量涌现。本文结合实际审查实践,分析该领域专利技术理解存在的困难,对该领域基础知识进行介绍并结合实际案情对提升该领域专利技术理解能力进行了阐述,以提高该领域专利审查质量和效率。

关键词:人工智能 理解发明 卷积神经网络 专利审查

一、引言

人工智能(Artificial Intelligence,简称AI)是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的技术科学。通俗而言,人工智能是研究如何使计算机去做过去只有人才能做的智能工作,起源于1956年的美国,基础理论和原创算法主要掌握在美国、英国、加拿大等国家手里,美国依靠技术先发优势,微软、谷歌、亚马逊、IBM等龙头企业已在人工智能全产业链实现全面布局。我国人工智能技术起步较晚,起步于1978年,在基础理论、底层框架、核心算法上积累薄弱,缺乏重大原创成果,在产业发展上过度依赖国外开源代码和现有数学模型,真正属于自己的东西并不多,近年来,主要聚焦于应用层,“虽然也开枝散叶,但树根不在国内”。

理解发明是专利审查工作中的一个关键步骤,决定了后续案件检索时检索方向的准确性、检索的效率以及案件走向的正确性。人工智能领域审查员在理解发明时面临的困难主要有:①人工智能技术发展迅速,应用场景十分广泛,新的算法和网络模型层出不穷,该领域的审查员需要不断学习新知识;②人工智能技术并非起源于我国,基础理论和核心算法主要是掌握在西方国家手里,该领域审查员在了解现有技术时存在技术理解不到位的问题;③该领域发明专利一般包含算法特征,技术方案较复杂、抽象;④人工智能是近十年来飞速发展的科学技术,目前该领域很多审查员在本科和研究生期间所学专业并非对口专业,因此该领域审查员在基础知识掌握上是欠缺的;⑤由于该领域专利申请量大,审查员审查任务较重,平时审查中主要关注单个案件涉及的技术,难以挤出时间对该领域的基础知识进行梳理。

尽管存在上述诸多困难,为了提高审查质量和审查效率,对该领域审查员而言,掌握本领域的必要基础知识是十分必要的。

二、人工智能领域的基础知识

人工智能领域的专利申请涉及的技术知识较多,笔者作为该领域有七年审查经验的老审查员,结合自身审查实践,对该领域中的卷积神经网络和常用的神经网络架构进行介绍,并结合实际案例分析掌握相关基础知识的必要性。

(一)、卷积神经网络:卷积神经网络(简称CNN)是人工智能领域中一个非常重要的概念,通常包括卷积层、池化层和全连接层,各种经典卷积神经网络架构及其改进网络都是由卷积层、池化层和全连接层组成的。因而熟悉卷积层、池化层和全连接层对于准确理解发明是必要的。

1.卷积层的作用是对输入图像进行特征提取,通过卷积核对输入图像进行遍历,将卷积核与输入图像对应位置处的值分别相乘并相加,得到输出特征图对应位置的像素的值。由上述卷积运算的实现过程可知,进行卷积运算时必然涉及卷积核大小、步长以及填充。在卷积运算时还会涉及输入和输出通道数,输入通道数是指输入图像的通道个数,对于彩色图像,输入通道数为3,即R、G、B三个通道,对于灰度图像,则只有一个通道;输出通道数是指输出图像包括多少个通道,其等于卷积核的个数。

2. 池化层的作用是对输入数据进行下采样,常用的池化方法有最大池化(max-pooling)和均值池化(mean-pooling)。

3. 全连接层,该领域审查员知晓带有全连接层的卷积神经网络,需要输入图像的尺寸固定,但很多审查员不明白其中的原因。实际上,全连接层是将输入的多维度的矩阵映射成为一个列向量,具体实现时,是将多维度的输入矩阵首先变换为一个列向量,然后将全连接层的参数矩阵W进行矩阵乘法运算,得到一个列向量。在对卷积神经网络进行训练时,其全连接层的参数矩阵的维度是预先设置好的,因此输入全连接层的多维度矩阵的维度也应该是固定的,否则无法进行矩阵相乘,由于卷积层和池化层的参数也都是预先设置好的,因此为了使得上述矩阵乘法能够执行,则需要输入图像的尺寸是固定的,此时经过预设的卷积层和池化层后得到的多维度矩阵的维度压平后才能与上述全连接层进行乘法运算。

下面通过一个案例来阐述对上述基础知识的掌握的重要性。

案例:申请人在答复第一次审查意见通知书时,将说明书中的如下公式补入权利要求中,认为对比文件没有公开该公式。

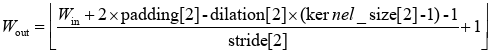

式中,Hin、Win表示输入图像的高度和宽度,Hout、Wout表示输出特征图高度和宽度,kernel_size为卷积核大小,padding为填充大小,stride表示步长,dilation默认值为1。

审查员在第二次审查意见通知书(简称二通)中补充检索对比文件(下称DA)评述上述公式,DA公开了如下公式:

申请人在答复二通时,认为DA公开的公式和本申请的公式完全不同,DA公式最后是“+1”,而本申请是“-1”。由于审查员基础知识的匮乏,在三通时继续补充检索多篇对比文件,多篇对比文件均在公式最后是“+1”,通过多篇文件证明本申请上述公式“-1”是错误的,应当是“+1”。本案四通后驳回。上述公式实际上是卷积神经网络中卷积后特征图大小的计算公式,属于本领域公知常识。但由于审查员缺乏对该知识的掌握,进行了多次补充检索,延长了审查周期,降低了审查效率。

(二)、常见的神经网络架构

通过熟悉人工智能领域常见的卷积神经网络结构,对该领域的技术发展状况有所了解,对于准确理解发明,正确认定发明与现有技术的事实,都是十分必要的。卷积神经网络经典网络模型包括LeNet、AlexNet、GoogleNet、VGGNet、ResNet、Faster R-CNN等,它们在人工智能的发展历程中具有里程碑式的意义。

1. AlexNet:2012年由Alex Krizhevsky等人提出,是卷积神经网络的开山之作。AlexNet一共包含8层,前5层由卷积层(其中卷积层1、2、5后含有下采样层,即最大池化层)组成,而剩下的3层为全连接层,最后一层全连接层的输出作为softmax的输入,得到1000个图像分类标签对应的概率值。

2. VGGNet:2014年提出,VGGNet探索了卷积神经网络的深度与其性能之间的关系,成功地构筑了16-19层深的卷积神经网络,证明了增加网络的深度能够在一定程度上影响网络最终的性能,使错误率大幅下降,同时拓展性又很强,迁移到其它图片数据上的泛化性也非常好。VGGNet可以看成是加深版本的AlexNet,其改进点在于使用多个较小的卷积核(3x3)的卷积层代替一个卷积核较大的卷积层。

3. Faster R-CNN:2015年提出,是人工智能领域常用的目标检测网络,首先通过CNN提取输入图像的特征,得到特征图;然后将该特征图分别输入RPN区域候选网络和RoI Pooling中,RPN用于得到特征图中的感兴趣区域,RoI Pooling用于将候选区域从输入特征图中提取出来,然后送入后续的全连接层中,用于输出目标的类别和位置。

三、总结

本文从人工智能领域专利审查员在理解发明时存在的难题出发,对人工智能领域基础知识进行了介绍,并结合具体案情分析掌握相关基础知识对准确理解发明的重要性。作为该领域审查员,在审查过程中要不断积累本领域基础知识,做到对本领域技术脉络的掌握,不断接近本领域技术人员水平,从而提升人工智能领域专利审查质量和效率。

参考文献

[1] 《人工智能领域的专利申请及保护》,张政权.出版日期:2019.10.

[2] 《图解深度学习》,山下隆义 著,张弥 译,出版日期:2018.05.